インタビュー

「Gemini Enterprise」が切り拓くAIエージェントの未来――Google Cloud・スラパネニ氏が語るフルスタックとオープンの強み

2026年5月1日 06:15

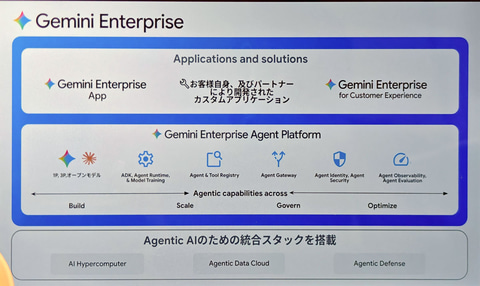

Google Cloudが4月22日~4月24日に開催した年次イベント「Google Cloud Next '26」では、AIエージェントにフォーカスが当てられ、同社の新しいAIエージェント構築環境となる「Gemini Enterprise」に関する発表が話題の中心となった。

今回は、Google CloudでGemini Enterpriseなどのビジネスを統括している、Google Cloud ビジネスアプリケーションプラットフォーム担当バイスプレジデント兼ゼネラルマネージャーのラオ・スラパネニ氏に話を聞く機会を得たので、本稿ではその模様をお届けする。

複数のAIエージェントを束ねて利用する時代に対応するGemini Enterprise

――今回のGoogle Cloud NextではGemini Enterpriseにフォーカスした内容になっていたが、従来Gemini EnterpriseだったSaaSアプリはGemini Enterprise Appとなり、Gemini Enterprise自体はそうしたSaaSやGemini Enterprise Agent Platformなどを総括したブランドになっている。なぜこうした変更が行われたのか?

我々が構築している全体的なプラットフォームとプロダクトのエクスペリエンスについて説明し、そこから今回のプロダクト進化の妥当性をお話ししたい。

今回の製品で一番上のレイヤーで始まるのがGemini Enterprise Appだ。これは、すべての従業員がすぐに使える、いわば“箱から出してすぐ使える”もので、AI、特にGeminiの力を使って、より多くのことをこなすためのものになる。

顧客はこれを活用することで、より生産性が高まり、単に情報を検索するだけでなく、アクションを実行したりノーコードのエージェントを自分の生産性向上のために開発できるようにする。「1週間を要約してステータスレポートを作成してくれるエージェント」をノーコードで作成する、そういう使い方が可能になるのだ。

私個人は、自分専用のパーソナルエージェントを持っていて、それを「チーフ・オブ・スタッフ」と呼んでいる。重要な会議に備える際に、このエージェントが深いリサーチを行い、情報を統合・要約してくれたり、私と一緒にブレインストーミングしてくれたりする。このように、企業内のあらゆるビジネスユーザーにとって、シンプルにすぐ使えるアプリ――それがGemini Enterprise Appなのだ。

これは、Gemini Enterprise Agent Platformという堅牢な基盤の上に構築されており、プラットフォームがアプリを支えているのだ。Gemini Enterprise Appが1つのアプリであり、もう1つが顧客体験の向上に注力した「Gemini Enterprise for Customer Experience」。このほかにも、顧客自身が独自のエージェントを構築することが可能だ。

つまり、Gemini Enterprise Agent Platformという土台があり、その上にアプリが載っているというのがGemini Enterpriseの全体像であって、Google AgentspaceとGemini Enterpriseが現在のGemini Enterpriseへと進化したため、そうした名称にしたのだ。

――従来GoogleはマネージドAIサービスとしてVertex AIを提供してきた。Vertex AIとGemini Enterprise Agent Platformの関係を教えてほしい。

Vertex AI Studio(Vertex AIで生成AIを構築するツール)は、我々が顧客に提供しているものをご体験いただくフロントドアだった。そこでは、AIモデルやいくつかのアプリケーション、そしてそれを使って構築できるユーザー体験が中心で、だから「スタジオ」という製品名がつけられていた。

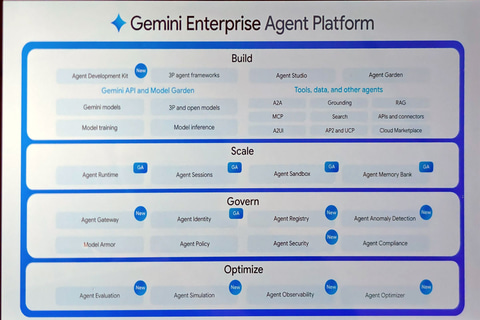

それに対して、今はあらゆる企業、あらゆるCIOやCTOにとってAIエージェントを構築することが最重要になっている。このため、それをAIエージェント対応に進化させる必要があったのだ。(Gemini Enterprise Agent Platformは)Vertex AI Studioが持つすべてのアセットを生かしているし、同じ機能を使って構築できるが、そこに「エージェンティック・ファースト」な考え方を持ち込んだものになる。

つまり、以前のVertex AI Studioでできていたことはそのままに、エージェントを構築できる機能が加わっているのだ。なぜなら今は、ほぼすべてのユーザーがエージェントを作ることから始めているからだ。そのため、プラットフォーム全体が、進化したのだ。

――Gemini Enterprise Agent PlatformはVertex AIが進化したもの、そうとらえればよいだろうか?

その通りだ。AIエージェントを構築するには、AIのモデルだけでなくアイデンティティの管理が必要だし、オーケストレーション(複数のエージェント間の調整)などが必要になるし、どのエージェントが使われているのかをチェックするようなガバナンスの機能が必要になる。管理者は「このエージェントは何をしているのか?」「どのタイミングで人間による介入が必要なのか?」を理解する必要がある。

そのため我々は「Inbox Experience」を作ったのだ。エージェントが何かを実行しようとしていて、人間の介入が必要な時にそのタスクが人間のInboxに表示される仕組みだ。人間が「OK、続行してよい」と判断したら、その情報をエージェント側が記憶し、Memory Bankという技術が働く。これを保存することで、次回同じことが起きた時には人間に再度確認せず、自律的に次のステップへ進めるようになる。

このようにして我々は「Build(構築)・Scale(伸縮)・Govern(統制)・Optimize(最適化)」というフェーズでAIエージェントの構築を説明している。つまり、より自律的なエージェントを目指して、これらすべての段階を実現しようとしているのだ。

オープンかつAIエージェントのオーケストレーションが可能なフルスタックの環境を提供できる点が強み

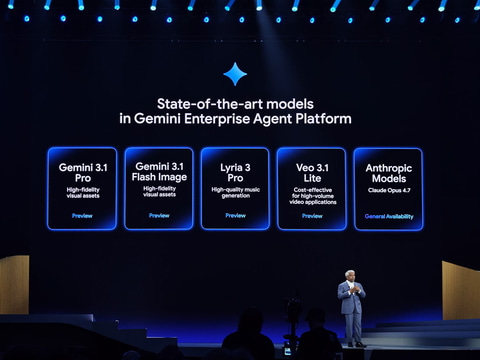

――従来、Googleは自社製AIモデルのGeminiを推しているという印象だったが、今回AnthropicのClaude Opus 4.7をGemini Enterprise Agent PlatformのAIモデルとして選択できるようにした。このことは方針の転換を示すことなのか?

はっきり申し上げたいのは、我々は常にプラットフォーム上で利用可能なモデルについてオープンであるということだ。もちろん我々としてはすべての顧客にGeminiを選択してもらいたいとは思っているが、同時に顧客に常に選択肢を提供したいと考えている。

例えば、我々のモデルガーデンを見ていただければわかるように、Gemma、Llamaのようなオープンソースモデルはこれまでも提供してきたし、今後も技術力がある顧客はそれを選んで活用してもらうことは可能だ。

サードパーティモデルに関しても同様で、今回Anthropicのモデルの提供を発表したが、どのAIモデルを選ぶかは顧客の選択次第だ。我々は最高のプラットフォームを構築するが、同時にプラットフォームをオープンにして顧客が自由に組み合わせられるようしたい。

例えば、IDの分野で言えば、我々が提供するIDプロバイダーを使っていただくことも可能だし、MicrosoftのEntra IDを使っていただくことも可能だ。それと同じように、顧客に我々のモデルを選択いただいてもよいし、他社のモデルを使って自分たちのエージェントを構築できる。我々が提供しているのはそういうプラットフォームなのだ。

例えば、ServiceNowやWorkdayなどのSaaSプロバイダーがそれぞれ独自のエージェントプラットフォームを持っている。そうした時に我々はAgent to Agentの相互運用性を提供しており、顧客はこのタスクにはこのエージェントを使い、別のタスクには別のエージェントを使うといった形で、複数のエージェントをオーケストレーションすることができるようになる。

例えば、新規雇用した従業員の入社プロセスを例に挙げてみよう。雇用当初の入社プロセスでは、Workdayのエージェントが担当し、その従業員にノートPCが必要であれば、そのノートPCの発注はServiceNowのエージェントが担当する。その従業員が営業担当であれば、どの顧客と話す必要があるのかというアカウント情報はSalesforceのエージェントが担当する――そういう形でエージェントの活用が進んでいくが、それらすべてをGemini Enterprise Appの中でオーケストレーションできるのだ。

そうすると、顧客はサイロ化(たこつぼ的に細分化すること)したエージェントを個別に使うのではなく、エンドトゥエンドでワークフローを自動化できるのだ。これがGemini Enterprise Agent PlatformとGemini Enterprise Appの力である。

――すでにMicrosoftもAIモデルのマルチベンダー化にかじを切りつつあって、かつてのようにAIモデルの良し悪しで差別化するという時代は過ぎ去ったように見えるが?

今、この業界は非常に急速に進化している。最終的に、我々は「お客さまにとって何が最善か」という観点で考えている。つまり、我々としては最良のプラットフォームを提供したい一方で、急速に変化するこの技術領域において、お客さまに選択肢を提供したい。しかし同時に、Googleが持つ差別化要因については誇りを持っている。

――Googleの競合他社に対する強みとは何か?

チップレイヤーからモデルレイヤー、プラットフォームレイヤー、そしてアプリケーションやエージェントそのものに至るまで、フルスタックでの強みがある。さらに我々はタスクフォースのレイヤーも発表している。我々の「プラットフォームアプローチ」と「オープンプラットフォームアプローチ」が短期的にも長期的にも勝つと信じている。

このため、顧客には選択肢を提供しつつ、最高のものも提供し、何でも統合できるオープンな能力を提供し続けるというのが我々の戦略だ。

――しかしながら、競合他社も「我々も素晴らしいソリューションを持っている」と言うだろう。Google Cloudだけの強みとは何か?

指摘の通り、レイヤーごとに見れば、競合他社も良いものを持っていると思う。しかしながら、このフルスタックすべてをそろえているプロバイダーはほかには存在しない。モデルを持っている企業はあってもハードウェアは持っていなかったり、ハードウェアはあっても上位レイヤーのスタックは持っていなかったりといったように、競合他社は皆、それぞれ何かしらを提供しているが「つぎはぎ」のようになってしまっている。それに対して、我々はフルスタックの環境を顧客に提供できているのだ。

――つまりはオーケストレーションが重要だということか?

その通りだ。基調講演で示したように、我々のモデル部門とハードウェア部門は密接に連携していることを理解してもらえたかと思う。それにより同じハードウェア、同じ電力枠から、より高い価格性能比を引き出すことができるのだ。それにより、そのメリットを顧客に還元することが可能になり、パフォーマンス面でも価格面でも我々が優位に立っている理由なのだ。

――今やどのAIモデルがよいかと言っている時代は過ぎ、今はどのAIエージェントがよいかということを競う時代になっている。AIエージェントに関してほかのベンダーとの差別化ポイントはどこにあるか?

最終的に何がよいのかは、顧客が持っているユースケースと顧客自身のベンチマーク次第だ。我々は差別化要因としてフルスタックを持っているため、その中で素早いフィードバックループを回していける強みがある。

ハードウェアが改善されれば、「それがモデルにどう役立つか」を考え、モデルが改善されれば、「それがエージェンティックプラットフォームにどう貢献するか」を考え、プラットフォームが改善されれば、「それをアプリにどう反映すればもっと良くなるか」を考えるといった形で、我々はフルスタックを自社で持っているので、そのループを非常に高速に回すことができるのだ。それが大きな強みになっている。

こうしたさまざまなパートナーやベンダーと組んで構築することは不可能ではない。しかし、その場合は細かい性能の向上や価格競争力の向上、あるいはまったく新しいユースケースの創出までは、なかなか到達しにくいのが現状だ。

例えば、我々の動画生成モデル(Veo)を見ていただくのが良い事例だ。我々はその能力、特にマルチモーダルなメディア生成において最高の能力を自前で持っているからこそ、マーケティング領域、営業領域、トレーニング用の動画生成など、非常に幅広いユースケースを顧客に提供できている。そして、それがまたエンタープライズ向けのエージェントをさらに強化することにもつながっているのだ。

今回のGoogle Cloud Nextの基調講演で使ったコンテンツの多くは、我々の動画生成モデルVeoで作られたものだ。従来ならマーケティング部門では、アイデアを練り、プロダクトマネージャーがラフを作り、広告代理店が何週間もかけて仕上げる、という流れだった。今では、その90%がプロダクトマネージャー自身で完結し、最後の仕上げだけを広告代理店が行う、という形になっている。これが、フルスタックを自前で持っていることの非常に大きなメリットだ。

AIエージェントへの移行でソフトウェアの形が定義型から非定義型に変わりつつある

――今目の前で起きていることは、かつてキャラクターベースのOSからGUIのOSへと切り替わっていったように、ソフトウェアのあり方が大きく変わっていっているように見える。

その通りだ。これまでのアプリケーションはすべて事前に動作が決まっていたが、AIはそうした動作を定義せずに処理を行う能力があり、それを前提にソフトウェアの形を再考していく必要が出てきているのだ。単に、既存のアプリにAIをちょっと足すのではなく、AIが多くのワークロードを肩代わりしてくれることを前提にプロセス全体を再設計する必要があるのだ。

ここで大きく変わったのは、「推論能力」と「思考能力」だ。これまでは、何かをリサーチしようと思ったら、大量のコンテンツを読み込んで理解し、比較し、競合調査や顧客調査を行うのに多くの時間がかかっていた。

今は、エージェントを1つデプロイして、「私はこのトピックに興味があるから、関連情報を全部集めてきて」と頼めば、そのエージェントが情報を収集し、統合して、きれいなレポートにまとめてくれる。それを活用すれば従来よりもはるかに生産的に仕事をすることが可能になる。そこから追加のフォローアップの質問をしたり、さらに深く掘り下げたりできる。

特にAIとリサーチの世界では、毎日のように新しい情報が出ていて、正直、自分1人ではとても追いきれない。だが、私は「リサーチ集約エージェント」を使って、世の中で起きていることをすべてウォッチし、要約してもらっている。

そのエージェントは、「それを自分のプロダクトにどう生かせるか」まで教えてくれます。以前なら、私はある分野の専門家に相談し、議論し、ミーティングを設定して――という流れだった。今はそれが一気に効率化され、全員の時間が節約されている。我々自身もAIを活用しながら、あらゆる職能で生産性を高められているのだ。

ほかにも、我々はサプライチェーンのシナリオにエージェントを導入している。AIデータセンターを素早く構築する必要があるので、エージェントを使って、さまざまな組み合わせを評価させているのだ。

「この地域でこの選択をして、このベンダーからこのパーツを注文すれば、ちょうど良いタイミングで機器が届き、結果としてデータセンターをこれまでより早く建設できる」といったシナリオを評価させている。このように、企業のあらゆる機能で、より生産的に、効率的に、より多くのことを試し、より速く前進できるようになっているのだ。

――確かに、我々記者の仕事でも文字起こしや要約などは、AIに任せた方がはるかに正確でかつ時短になっていて、記者は書くことに集中できるようになっている。

今回のGemini Enterprise Agent Platformの発表では、新しいツールとして「Memory Bank」が追加されている。これにより、長時間稼働するエージェントの機能などを実現可能で、企業がAIをアシスタントから一歩進んで、あらゆる業務の真のパートナーとなるエージェントに進化していく姿が少しずつ形になっている。

――今回MCPに関する発表も多かったが、基調講演などでは昨年発表されたA2A(Agent to Agent)に関する新しい発表はなかった。A2Aの現状について教えてほしい。

昨年の今ごろ、約60社のパートナーと共にA2Aを発表した。現在ではそれが150社以上に拡大しており、急速に採用が進んでいる。そうしたことが進んでいるのは、我々がなぜA2Aを提案したのかというある仮説に基づいている。それは「顧客が、それぞれ独立したエージェンティックプラットフォームを持ち、その中にブラックボックス的なエージェントを保持したいというニーズがある」ということだ。

MCPは1つのエージェントの中から、データやツールへアクセスするための仕組みだ。例えば、サプライチェーンのシナリオで、さまざまなベンダーのエージェントが、それぞれサプライチェーンの一部を担当しているケースを考えてみたい。

ある大手PCメーカーでは、需要予測エージェント、在庫管理エージェント、ベンダーが提供する出荷時間エージェントなどがあり、これまでは人間がそれぞれのエージェントと個別にやり取りしていたが、今ではこれら複数のエージェントをオーケストレーションし、「需要を満たすために、最適な発注計画は何か」を提案させることができている。こうした縦割りのエージェントを、それぞれ別チームが作っているような場面で、それらを横断的にオーケストレーションするためにA2Aが使われているのだ。

通信事業者の世界でも同様の動きがある。A2Aはセキュアで、タスクベースで、認証されたやり取りが可能になるためだ。通信事業者はルーター内にエージェントを配置し、そのエージェント同士が、ほかのエンドポイントとエージェント的な方法でやり取りするようなユースケースを展開している。そこでは、分析・モニタリングから、機能変更までをカバーしているのだ。

A2Aが、それらを接続し、オーケストレーションするための手段としてますます重要になってきているのだ。既にGemini Enterpriseでは、サードパーティのエージェントやパートナーのエージェントはすべてA2A対応になっている。実際に我々のマーケットプレイスを見ていただけるとわかるように、WorkdayやServiceNow、SAPなどのパートナーエージェントが既にA2Aに対応している。エージェントが成熟していくにつれ、A2Aがどんどん一般的になっていっている、我々はそう見ている。