イベント

エージェント型Geminiの時代へ~新Gemini Enterpriseと新TPUがその構築を後押し

Google Cloud Next '26基調講演

2026年4月24日 06:15

Alphabet傘下のクラウド部門Google Cloudは、4月22日~24日(米国時間)に、同社の年次イベント「Google Cloud Next '26」を、米国ネバダ州ラスベガス市のマンダレイベイ・コンベンションセンターで開催している。

初日となった4月22日には、同社CEOのトーマス・クリアン氏ら幹部が登壇してオープニング基調講演が行われ、エージェント型AIを実行するマネージド環境となる「Gemini Enterprise Agent Platform」など、エージェント型AIに特化したソリューションの提供が明らかにされた。

また、その演算環境となる新しい第8世代TPUとして、学習向けのTPU 8t、推論向けのTPU 8iなどが投入され、ソフトウェアからハードウェアまで、エージェント型AIを実行できる環境をフルスタックで提供できるとクリアン氏は強調した。

ビデオで登場したGoogle CEO ズンダー・ピチャイ氏は「われわれはすでにエージェント型Geminiの時代(Agentic Gemini Era)に突入している」と述べ、エージェント型AIの時代が本格的に到来していることを強調した。

エージェント型AIのテスト段階は終わり、実用段階に――「エージェント型Geminiの時代」へと突入

Google CloudのクリアンCEOは、「昨年のGoogle Cloud Nextでは、AIの未来に関しての説明を行った。そこから1年が経ち、その未来はこれまでにないような規模で本番稼働している。過去1年で起きたことは、新しいソリューションの導入ではなく変革だ。Google Cloudの約75%の顧客が、われわれのAI製品をビジネスに活用している。業界を横断する何千ものAIエージェントやサービスが、グローバルなネットワークを通じて顧客に届いている。もう実験のフェーズは終わり、導入後に本当の課題を見つけることが始まっている。その答えは統合されたAIスタックだ。バラバラのシリコンや分断されたモデルを寄せ集めるだけでは価値を提供することができない。価値を提供するには、チップがモデル向けに設計され、モデルがデータに基づき、AIエージェントとアプリがAIモデルで構築され、インフラで保護されている――そうしたアーキテクチャが必要になるのだ」と述べ、AIやAIエージェントがもはや導入を検討する段階から、実際に稼働させていくフェーズになっていると説明した。

その上で、Google Cloudの「カスタマーゼロ」(社内やグループ内での顧客のこと)として、同じAlphabet傘下のGoogleを紹介し、Google CEO ズンダー・ピチャイ氏がビデオで登壇した。

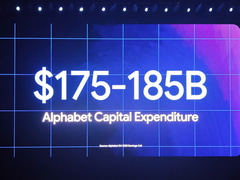

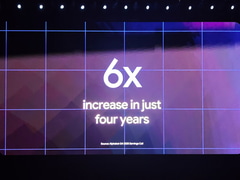

ピチャイ氏は「GoogleはAIの導入に野心的に取り組んできた。2022年には設備投資に310億ドルを投じたが、本年は1750億~1850億ドルの投資を行う計画で、わずか4年でほぼ6倍の増加となっている。そうしたAI用投資で実現する演算リソースの半分はクラウド事業に向かう見込みで、Google Cloudのお客さまに大きな恩恵をもたらすと考えている」と語った。

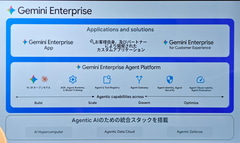

そして、「何よりもわれわれ自身がGoogle Cloudのカスタマーゼロなのだ。既にわれわれはGeminiに大きな取り組みを進めてきたが、これからはエージェント型Gemini時代へと突入していく。昨年、GoogleはGemini Enterpriseを導入したが、今年はそれを拡張し、Gemini Enterprise Agent Platformを発表する」と述べ、Googleがエージェント型Geminiの時代(Agentic Gemini Era)と呼んでいる、エージェント型AIが当たり前になっていく時代に対応した新しいGemini Enterpriseおよび、その基盤となるGemini Enterprise Agent Platformを発表した。

Vertex AI改めGemini Enterprise Agent Platformにより、エージェント型AIの導入を容易に

今回Google Cloudが発表したのは、新しいGemini EnterpriseおよびGemini Enterprise Agent Platformだ。昨年発表された従来のGemini Enterpriseは、SaaSベースでGoogle WorkspaceやMicrosoft 365などのAI機能を提供するサービスとして展開されてきた。企業はGemini Enterpriseを契約すると、ChatGPTやClaude、Microsoft 365 Copilotなどの法人向けAI機能を利用できるようになっていた。

それに対して今回発表された新しいGemini Enterpriseは、GoogleのマネージドAI製品の総称になる。旧来のGemini Enterpriseを含む、AIエージェントやエージェント型AIを実行し、活用する環境の総称として今後Gemini Enterpriseの名称で呼ばれることになる。

そして、新しいGemini Enterpriseの傘の下に、SaaSであるGemini Enterprise Apps(従来のGemini Enterpriseから名称変更されたSaaS製品)、Gemini Enterprise for Customer Experienceなどのデジタルマーケティングツールが提供され、その下位レイヤーとしてGemini Enterprise Agent Platformが用意される形になる。

Gemini Enterprise Agent Platformは、基本的に、従来Google Cloudが「Vertex AI」と呼んできたAIマネージドサービスの名称を変更したもので、AIエージェント/エージェント型AI向けの機能が追加された機能向上版となる。

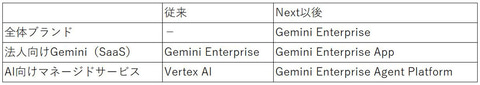

まとめると以下のような形だ。

Google Cloudによれば、Gemini Enterprise Appsの基本的な機能は従来のGemini Enterpriseとほぼ同じで、同時に、Gemini Enterprise Agent Platformも従来のVertex AIと同様になる。

ただし、いずれもAIエージェント/エージェント型AI周りの機能が強化されており、ピチャイ氏のいうところの「エージェント型Gemini時代」に備えた製品群に整理されたと考えることができる。

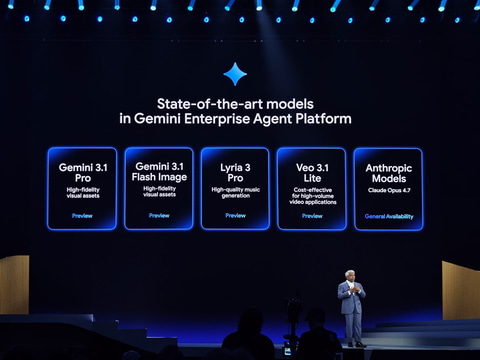

また、新しいモデルとして、Gemini 3.1 Pro、Gemini 3.1 Flash Image(いわゆるNano Banana)、Lyria 3 Pro、Veo 3.1 Liteなどの自社開発AIモデルの最新版がプレビュー投入されることや、Claude Opus 4.7という他社モデルがGemini Enterprise Agent Platformで選択できるようになったことが明らかにされている。

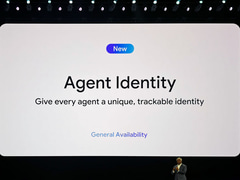

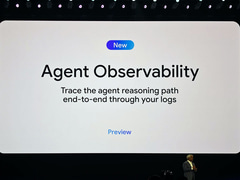

また、Gemini Enterprise Agent Platformの新機能としてAgent Registry、Agent Gateway、Agent Identity、Agent Observabilityなど、AIエージェントの管理をより効率よく行う仕組みが導入されたことも説明された。

学習用のTPU 8tと推論用のTPU 8iに分離して提供されるようになった第8世代TPU

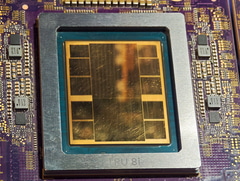

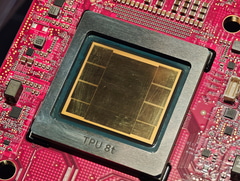

AIインフラ(CPU/GPU/TPUなどのAI学習/推論向けの)の強化も、もう1つの大きな発表だ。今回Google Cloudは、同社がAIの学習、推論向けに特化したTPU(Tensor Processing Unit)の第8世代製品を発表した。

同社のTPUは、これまで主に学習に特化してきたが、昨年のIronwood(第7世代)で学習と推論の両用とし、大規模・小規模の両方のクラスター構成を用意することで、前者を主に学習用、後者を主に推論用として提供してきた。

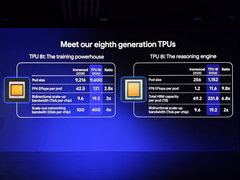

しかし、チップレベルでは1チップのみが提供されていた。これに対して、今回の第8世代TPUでは、学習用(Training)としてTPU 8t、推論用(Inference)としてTPU 8iという2種類のチップが用意される。

前者は、より大規模なネットワーク――最大9600基までの接続に対応でき、より大規模な演算装置を必要とする学習用として位置づけられている。

後者では、Ironwood世代の256基から1152基まで、スケールアップできる接続数が大きく拡大した。さらに、メモリがTPU 8tの216GBから288GBに増やされているほか、キャッシュとなるSRAMの容量が8tの128MBから384MBに増やされており、メモリに低遅延、広帯域でアクセスすることが可能で、推論のような低遅延の処理を求められる環境で効果を発揮する。

またこれまでは、これらのTPUに搭載されるCPUはx86プロセッサーだったが、今後はGoogleが自社開発したカスタムCPU「Axion」が採用されることも同時に発表されている。

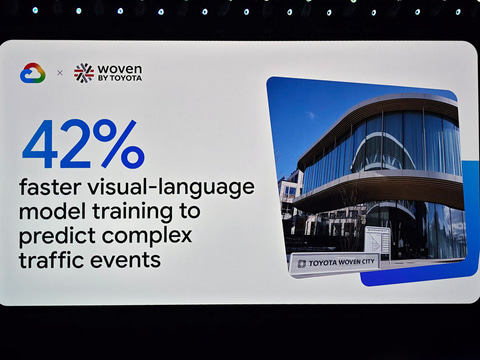

なお、TPUを大規模に利用している顧客として、新たに、トヨタ自動車の子会社でソフトウェア開発を担当しているウーブン・バイ・トヨタ(Woven by Toyota)などが明らかにされ、Visual Language Model(いわゆるコンピュータビジョンの機能に特化したLLMのこと)の学習が42%高速になったと明らかにしている。

Google Cloudが投入したAI用演算装置はTPUだけではない。NVIDIAが1月のCESで発表した、CPUにVera、GPUにRubinを採用し、ラック内で72GPUまでスケールアップしているVera Rubin NVL72も、ほかのクラウドサービス事業者に先駆けて提供すると明らかにした。A5XのVM(いわゆるインスタンス)として投入され、今年中に一般提供を開始する予定だという。

Google 上級副社長兼AI・インフラストラクチャ担当技術責任者アミン・ヴァーダット氏は、「われわれはTPUだけ、GPUだけを投入するのではなく、用途に合った、お客さまが求めるものを提供していく」と述べ、これからもTPUとGPUの双方を提供していくと明らかにした。

Google Workspace用にAI基盤「Workspace Intelligence」を追加してAI機能を強化

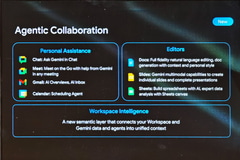

SaaSベースで提供されている法人向けの生産性向上ツール「Google Workspace」に関してもアップデートが明らかにされた。Workspace IntelligenceというAIをベースにした新しい基盤が追加され、以前から提供されてきたパーソナルアシスタントの機能や文書編集などの機能が強化される。

なお、Workspace Intelligenceは、ユーザーの動作から人間関係などを理解できる。例えば、この人は上司で、この人は同僚で――といったことを把握するため、上司からメールが来たら早めに返信を促すといった機能を提供可能になるという。

また、Google ChatではGeminiに問い合わせできるようになる。例えば、過去のミーティングについて聞くと、その話題に関する情報などをGeminiが示してくれる。

Google Meetでは、「Gemini in any Meeting」という、スマートフォンやPCなどのマイクを利用して集音した内容を文字起こしする機能が用意される。これにより、オフラインの会議(対面会議)でも議事録を作成可能になる。

また、Google Slidesを利用した複数スライドの自動生成機能の実装も発表され、実際にデモが行われた。

BigQueryを他社クラウドに低価格で拡張できるCross-Cloud Lakehouse、WizとGoogle Cloudの協業などについても説明

このほか、AIのデータを利活用するツールとして「Knowledge Catalog」、「Deep Research Agent」、「Lightning Engine for Apache Spark」などが発表されたほか、「Cross-Cloud Lakehouse」のプレビュー提供が明らかにされた。

Cross-Cloud Lakehouseは、Google Cloudが提供しているマネージド型データウェアハウス(DWH)「BigQuery」のAI分析機能を、Amazon Web Services(AWS)、Microsoft Azureなど、ほかのクラウドサービス事業者のクラウドサービスへと拡張するものだ。Iceberg REST Catalogなどのオープンスタンダード、Cross-Cloud Interconnectによる広帯域ネットワーク、透過的なキャッシュ技術などを活用することで、他社が自社サービス向けに提供しているDWHと同様の性能とコストを実現する。

現在、多くの大企業では、1つのクラウドサービスだけでなく複数のクラウドサービスやオンプレミス上にデータが分散しており、学習や推論を行うたびに、データをコピーし、そのたびに高い移動費を払うということになっている。Cross-Cloud Lakehouseは、それを解決するためのソリューションで、今回の基調講演ではVodafoneの事例が紹介され、年間1億ユーロのコスト削減効果が期待されていると説明された。

また、エージェント型AI/AIエージェント時代になることで、セキュリティへの新しい懸念が高まりつつある。これは、どんな新しいソフトウェアが誕生した時にも起こりうる懸念だ。そこでGoogle Cloudは3月31日に、クラウドおよびAIセキュリティ基盤を提供するWiz社の買収を完了し、独立したブランドのまま運営することを明らかにしている。

今回の基調講演には、Wiz 共同創業者兼 CEO アサフ・ラッパポート氏が登壇し、Wizのセキュリティソリューションが、Google CloudのAIエージェント基盤向けにセキュリティ機能を提供していく様子などをデモした。

講演の最後にクリアン氏は「われわれは、未来のAIはオープンであるべきだと考えている。競合他社がモデル、データ、エージェントをベンダーロックインしようとしているのに対して、われわれは演算基盤、データ基盤、セキュリティ基盤、エージェント基盤などをフルスタックで提供しながら、顧客が自分で自分の行く道をコントロールできる自由度の高い管理性を提供している。そうしたGoogle Cloudが提供するエージェント型AIの環境を活用して、素晴らしいエージェント型AIを作り上げてほしい」と述べ、Google Cloudのエージェント型AIを高い自由度で、かつ高いセキュリティを担保しながら作れるフルスタックの環境を提供しており、顧客に素晴らしいエージェント型AIを構築してほしいと述べ、講演をしめくくった。