ニュース

リコー、推論性能の強化によりGPT-5と同等の日本語LLMを開発

2025年10月10日 16:02

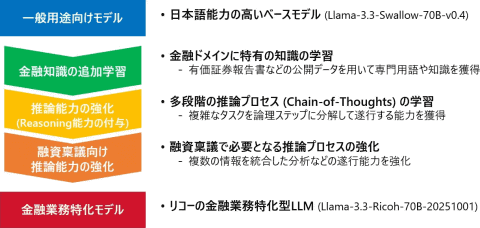

株式会社リコーは10日、リーズニング(推論)性能を追加搭載し、同社が開発・提供するオンプレミスで導入可能な700億パラメータの日本語大規模言語モデル(LLM)の性能を向上させたと発表した。

「金融業務特化型LLM」では、有価証券報告書などの公開データを用いて金融業特有の専門用語や知識を追加学習させた上で、多段推論能力(Chain-of-Thoughts:CoT)を付加することで、融資稟議業務などをはじめとする専門的な業務遂行能力を強化した。

開発したLLMについて、複雑な指示やタスクを含む代表的な日本語ベンチマーク「ELYZA-tasks-100」や、日本語のマルチターンの対話能力を評価する「Japanese MT-Bench」、日本語金融ベンチマーク「japanese-lm-fin-harness」、および金融業向けに独自開発したベンチマークにより、性能を評価した。

その結果、「金融業務特化型LLM」は、日本語ベンチマークにおいて米OpenAI社のGPT-5と同等レベルのスコアを示した。また、金融ベンチマークではパラメータ数が同規模以上の最先端オープンソースモデルを上回るスコアを示したという。

リコーは今後、製造業や医療といった他の業種・業務に適用可能な特化モデルの開発を進め、「使える・使いこなせるAI」を提供し、顧客が取り組むオフィス/現場のDXを支援していくとしている。