ニュース

リコー、モデルマージによりGPT-4oと同等性能の700億パラメーター日本語LLMを省コスト・省リソースで開発

2025年4月3日 14:02

株式会社リコーは3日、米Meta Platformsが提供する「Llama-3.3-70B-Instruct」の日本語性能を向上させた「Llama-3.3-Swallow-70B-v0.4」をベースモデルに、同社のInstructモデルから抽出したChat Vectorと、リコー製のChat Vectorを独自のノウハウでマージすることで、リコーが開発・提供する700億パラメーターの日本語大規模言語モデル(LLM)の性能を向上させたと発表した。

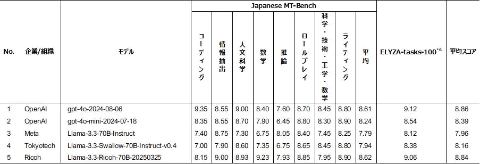

ベンチマークツールによる検証の結果、米OpenAIが開発したGPT-4oと同等レベルの優れた性能が確認された(2025年3月25日時点)。複雑な指示・タスクを含む代表的な日本語ベンチマーク「ELYZA-tasks-100」と、日本語のマルチターンの対話能力を評価する「Japanese MT-Bench」の、2つのベンチマークツールを組み合わせて平均スコアを比較した。リコーがモデルマージの手法で開発したLLMは、GPT-4o(gpt-4o-2024-08-06)と同等レベルの高いスコアを示した(評価には「gpt-4o-2024-08-06」を使用)。

これにより、高性能でありながら、省コスト・省リソースを実現しており、今後はオンプレミス環境で顧客情報の追加学習が可能なプライベートLLMとして、企業内での導入を支援するとしている。

生成AIの普及に伴い、企業が業務で活用できる高性能なLLMへのニーズが高まっているが、LLMの追加学習には高コストかつ長時間を要するという課題がある。こうした課題に対し、複数のモデルを組み合わせて高性能なモデルを構築する「モデルマージ」が、効率的な開発手法として注目されている。

リコーは、モデルマージのノウハウとLLM開発の知見を生かし、新たなLLMを開発した。同技術は、企業独自のプライベートLLMや特定業務向けの高性能LLMを効率的に開発するための一助になると説明。リコーは、自社製LLMの開発にとどまらず、顧客の用途や環境に最適なLLMを低コスト・短納期で提供するために、多様で効率的な手法・技術の研究開発を推進していくとしている。