ニュース

NRIセキュア、AIエージェントシステム設計時に潜在脅威を可視化・分析する「AI Yellow Team」

設計段階でのセキュリティ対策の立案を支援

2025年7月30日 10:00

NRIセキュアテクノロジーズ株式会社(以下、NRIセキュア)は29日、AIエージェントシステムを構築する企業向けに、設計段階で潜在脅威を洗い出し、対策案を提示するサービス「AI Yellow Team」を提供開始すると発表した。

「AI Yellow Team」は、AIエージェントシステムを設計する段階において、NRIセキュアの専門家が4つのステップに沿って、システム開発・運用段階で発生する可能性のある脅威を洗い出して分析し、セキュリティ対策の妥当性を評価し適切な対策を提案するサービス。「OWASP Top10 for LLM」や「Agentic AI - Threats and Mitigations」といった国際的なガイドラインを基に、最新動向やNRIセキュアのAIセキュリティに関する知見も融合しており、AIエージェントを組み込んだシステムに対する最新の攻撃シナリオにも対応するという。

具体的なステップとしては、1つ目の「ヒアリング」において、設計書を基に、システムアーキテクチャ、仕様をNRIセキュアの専門家がヒアリングする。そして2つ目の「可視化」で、外部システムとの結合を含めた、各機能における脅威分析用のアーキテクチャとデータフロー図を作成する。

また3つ目の「脅威分析」で、作成したアーキテクチャとデータフロー図を基に、システムに対する潜在的な脅威の洗い出しを実施。脅威の埋め込みから発動までのシナリオを検討し、想定されるリスクを分析する。

そして最後の「セキュリティ対策の提示」において、洗い出された脅威に対する具体的な対策を「セキュリティ要件一覧」として提示する。

成果物には潜在的な脅威が一覧化されており、脅威ごとにリスクがどこで発生し、どのように顕在化するかといった経過や、具体的な対策としてのセキュリティ要件がまとめられている。このため、開発者が潜在的な脅威を十分に把握したうえで、開発段階から優先して実行すべきセキュリティ対策を検討できるとした。さらに、経営層などにリスク評価の結果や対策方針を説明し、社内理解を得る際にも役立つとのこと。

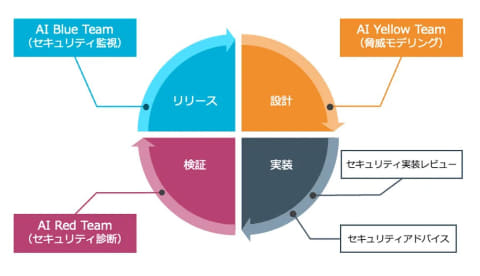

なお、NRIセキュアは、AIを活用したシステムを対象に、リリース前のセキュリティ診断を行うサービス「AI Red Team」と、リリース後のセキュリティ監視を行うサービス「AI Blue Team」をすでに提供している。今回発表された「AI Yellow Team」は、システム開発の設計段階でセキュリティ対策を推進することを目的としており、各段階においてこれらのサービスを活用することで、より安全性の高いシステムの構築と運用を実現するとのことだ。