ニュース

リコー、図表を読み取れるリーズニング性能を備えたマルチモーダル大規模言語モデルを開発

2026年3月31日 11:40

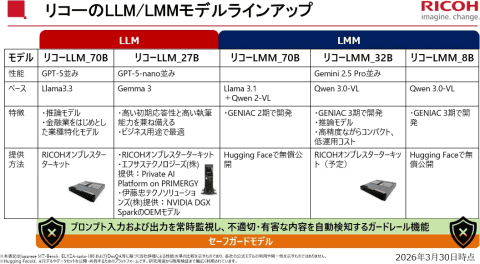

株式会社リコーは30日、経済産業省と国立研究開発法人新エネルギー・産業技術総合開発機構(NEDO)が実施する、国内における生成AIの開発力強化を目的としたプロジェクト「GENIAC(Generative AI Accelerator Challenge)」第3期において、図表を含む多様なドキュメントを高精度に読み取れるリーズニング性能を備えた、マルチモーダル大規模言語モデル(以下、リーズニングLMM)の基本モデル「Qwen3-VL-Ricoh-32B-20260227」の開発を完了したと発表した。

Qwen3-VL-Ricoh-32B-20260227は、多段推論を通じて複雑なドキュメントを理解できる点を特徴とする。また、同モデル開発で適用した技術を活用した軽量モデル「Qwen3-VL-Ricoh-8B-20260227」の無償公開を開始した。さらに、リーズニング性能の評価に特化したリコー独自開発のベンチマークツールについても、今後公開する予定としている。

リコーは、2024年8月から実施されたGENIACの第2期において、700億パラメーターのLMMを開発し、その基本モデルおよび独自開発のベンチマークツールを無償公開した。また、2026年1月には、中国のアリババクラウドが開発・提供する大規模言語モデル(LLM)ファミリーの「Qwen2.5-VL-32B-Instruct」をベースとした320億パラメーターのコンパクトなLMMを開発した。

第3期では、「Qwen3-VL-32B-Instruct」をベースに、多段推論によって複雑なドキュメントを高精度に理解できるリーズニングLMMの基本モデル「Qwen3-VL-Ricoh-32B-20260227」を開発した。同モデルでは、強化学習やカリキュラム学習といった学習手法の工夫により、複数ページにまたがる図表を関連付けて理解し、読解難易度の高い質問に対しても、高精度な回答を生成することが可能になった。強化学習では、独自の報酬関数を設定することで、学習効率を高めるとともに、過学習を抑制している。また、カリキュラム学習では、難易度設定と学習ペースの最適化を行った。

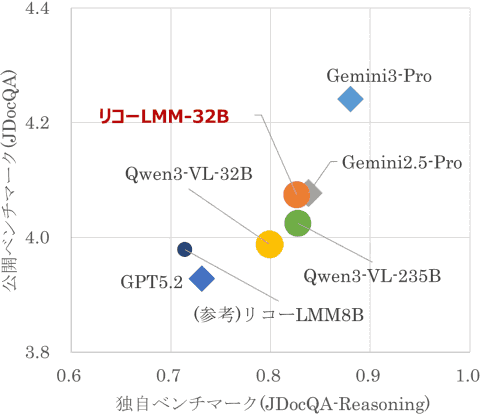

これらの取り組みにより、「Gemini2.5-Pro」などの大型商用モデルと同等のベンチマーク結果を確認している(2026年2月17日時点)。同モデルのリーズニング性能を評価するため、リコーは独自のベンチマークツールを開発しており、今後公開する予定。

さらに、日本企業での実務利用を想定し、思考プロセスの日本語化にも取り組んだ。これにより、日本語文書の読み取り精度向上に加え、回答の判断根拠や前提条件を日本語で確認できるようになり、実務利用における信頼性を高めている。

リコーでは、セキュリティ、プライバシー、ガバナンスの観点から、オンプレミスや自社データセンターなどの社内専用環境でAIを利用したいと考える企業は多く、省リソースでAIを活用できる環境へのニーズが高まっていると説明。

今回開発したモデルは、オンプレミス環境での導入が可能で、企業の業種・業務に応じたファインチューニングにも対応する。また、企業内での活用を加速するためには、開発コストや運用コストの低減も重要な課題だとして、リコーはモデルマージ技術(複数の学習済みLLMモデルを組み合わせて、より性能の高いモデルを作る方法)の活用により、効率的な開発プロセスを確立し、プライベートモデルの提供に活用していく。さらに、独自の画像トークンの圧縮技術を用いることで、高性能化に伴い増大する運用コストの低減にも取り組むとしている。