ニュース

「生成AIを使った攻撃は脆弱性を仕込む必要もない」――EYSCが攻撃者視点で生成AIのリスクを評価するサービスを提供開始

2026年5月15日 11:00

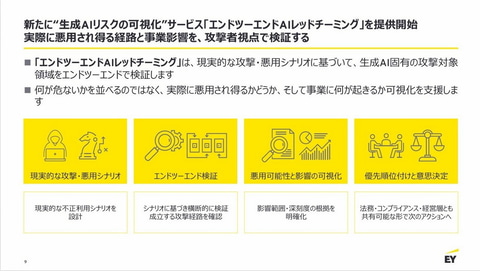

EYストラテジー・アンド・コンサルティング株式会社(以下、EYSC)は14日、攻撃者視点で生成AIのセキュリティリスクを把握し評価するサービス「エンドツーエンドAIレッドチーミング」を提供開始すると発表した。

同サービスは、生成AIやLLMを搭載したアプリケーションを対象に、プロンプトの入力から生成AIによる結果出力までの挙動を包括的に分析する。その上で、想定される攻撃シナリオを用いた検証を通じ、従来の診断手法ではとらえきれなかったAI特有のリスクを特定し、その影響を評価する。

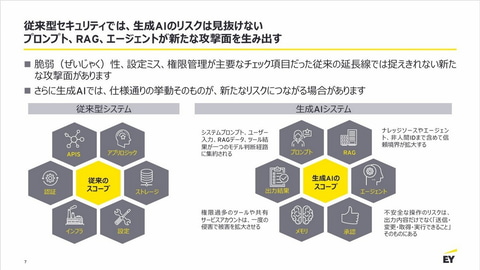

EYSC テクノロジーコンサルティング サイバーセキュリティユニット アソシエートパートナーの佐藤拓也氏は、「生成AIの導入が急速に進んでいる一方で、多くの企業はそのセキュリティリスクに適切に対応できていない」と話す。その理由について、「生成AI特有のリスクは従来のセキュリティ対策の延長線上にはない。既存のツールや評価手法がそのまま適用できず、何をどう評価をすればいいのか、方法論自体まだ確立されていないのが現状だ」としている。

生成AI特有のリスクとはどういったものなのか。佐藤氏によると、従来のアプリケーションに対する攻撃では、脆弱性や設定の不備を突く手法が中心で、専門知識やツールが必要だったが、生成AIではプロンプトそのものが攻撃の入り口となり、自然言語だけでシステム操作を誘導できてしまう点が課題だという。また、AIが参照する外部ドキュメントやデータベースに悪意のある指示を埋め込むことで、間接的にAIを操作することもできるほか、外部システムに対しアクションを実行できるエージェントの場合はその権限自体が攻撃対象となり、それを踏み台としてシステムを操作する危険性もあるという。

「これらは従来のセキュリティリスクでは想定されていない。攻撃者はもはやコードに脆弱性を仕込む必要も、ファイアウォールを突破する必要もなく、巧妙なプロンプトさえ用意できればシステムを操作できてしまう。しかもプロンプトは最終的な出力に至るまで連鎖的に影響を与えるため、個別のリスクだけを見ても不十分で、生成AIアプリケーション全体がどのように振り回されるかをエンドツーエンドで評価することが重要だ」と佐藤氏は述べ、今回のサービス提供に至った背景を説明した。

エンドツーエンドAIレッドチーミングは、まず実際に発生し得る攻撃や悪用シナリオを具体的に想定することから始まり、そのシナリオに基づいて利用フロー全体をエンドツーエンドで検証、どのような事象が起こり得るのかを明らかにする。その検証結果を踏まえ、攻撃が現実的に発生する可能性があるのか、悪用される可能性はどの程度か、発生した場合の影響はどの程度かといった点を評価し、最終的には経営判断に資するレポートとして提供する。このレポートでは、どのようなリスクが存在し、どの程度の影響を及ぼすのか、そしてどのリスクから優先的に対応すべきかを示し、経営層が適切な意思決定を行えるよう支援する。

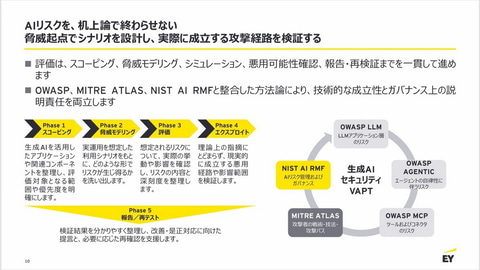

リスクの可視化にあたっては、1.スコーピング、2.脅威モデリング、3.評価、4.エクスプロイト、5.報告・再テスト、という5つのフェーズでアプローチする。

まずスコーピングでは、生成AIを活用したアプリケーションの構成要素を整理し、使用しているLLMの種類やRAGの仕組み、外部APIとの連携有無などを踏まえて攻撃面を洗い出し、評価対象の範囲と優先度を明確にする。続く脅威モデリングでは、利用シナリオを想定し、攻撃者がどのような手法でリスクを引き起こすか検討して、現実的な攻撃シナリオを組み立てる。

評価フェーズでは、想定したリスクがどのような挙動や影響をもたらすか確認し、リスクの内容と深刻度を整理する。さらにエクスプロイトでは、理論上の指摘にとどまらず、実際に成立する悪用経路や影響範囲を検証する。最後に報告・再テストとして、検証結果を分かりやすくまとめ、改善に向けた提言を提示し、必要に応じて是正後の再確認を行う。

エンドツーエンドAIレッドチーミングの価値について佐藤氏は、「生成AIに潜む見えないリスクを、経営層が判断できる形にまで可視化する点にある」と説明する。「多くの企業では、生成AIに何らかのリスクがありそうだと感じながらも、具体的にどこが問題か分からないためセキュリティ対策が後回しになり、予算確保も難しくなっている。今回のサービスでは、そうしたあいまいな不安を再現可能な証拠として提示する」(佐藤氏)

佐藤氏は、生成AIのセキュリティリスクを恐れて導入を避けるという選択は適切ではないとし、「重要なのは、リスクを正しく把握した上で適切に対処し、安心して活用できる状態をつくること。エンドツーエンドAIレッドチーミングは、リスクを知った上で使うという持続可能なAI活用の基盤づくりを支援する」と述べた。