イベント

「競合はもはやAWSやAzureではない」――OpenAIやAnthropicと切り結ぶ“エージェント型AI”時代へ

グーグル・クラウド・ジャパン三上代表

2026年4月27日 06:30

Alphabetのクラウド部門「Google Cloud」は、米国時間4月22日~4月24日の3日間に、同社の年次イベント「Google Cloud Next'26」を開催した。それに合わせて、会期2日目(4月23日)には、同社の日本法人となるグーグル・クラウド・ジャパン合同会社の幹部が集まり、報道関係者からの質疑応答に応じた。

この中で同社の日本代表、三上智子氏は「Google Cloudとしては、すでに自社のビジネスを単なるクラウドサービス事業だとは考えておらず、エージェント型AIを中心としたAI事業にシフトしている。従来的な意味でのクラウド事業の競合を競合とは見ていない。むしろ、お客さまでもあるOpenAIやAnthropicが潜在的な競合だと考えている」と述べ、Google CloudはもはやフルスタックのAIソリューションが事業の中心であり、AWSやMicrosoft Azureは競合ではなく、AIサービスなどで競合しているOpenAIやAnthropicの方が競合企業になっていると指摘した。

AIエージェント/エージェント型AIをフルスタックで提供できると強調

冒頭でグーグル・クラウド・ジャパン合同会社 日本代表 三上智子氏は「Google Cloudに来てから初めてのNextで、実際会場に来てみて熱気がすごいというのが感想。発表内容からも“エージェント時代”への移行が一段と明確になった印象だ。特に、われわれ自身のサービスとして、エージェントを実運用に組み込み、実行・セキュリティ・ガバナンス・オブザーバビリティ等、エンタープライズ利用に必要な実装準備を支援するサービスを発表できた点は意義が大きい」と話す。

また、「日本からは1000名超の顧客が来場しており、2日間にさまざまな会合を含め多面的なエンゲージメントを実施した。顧客からの反応はおおむね良好であり、フルスタックかつオープンであるというGoogle Cloudの強み、ならびに独自の提供価値が高く評価していただいている」と述べ、GoogleのNextにおける各種発表がいずれもAIエージェント/エージェント型AIに関する内容で、それをフルスタックでかつオープンな仕組みで提供できることがGoogle Cloudの強みであると再実感したと強調した。

今回Google Cloudは、AIハイパーコンピュータ(CPU/GPU/TPUなど演算環境)、エージェント型データクラウド(AIに最適化されたクラウド型データベース)、エージェント型防御、エージェント型プラットフォームモデル、エージェント型タスクフォースといった5層のスタックを掲げ、それぞれに対応した製品を投入していると説明した。

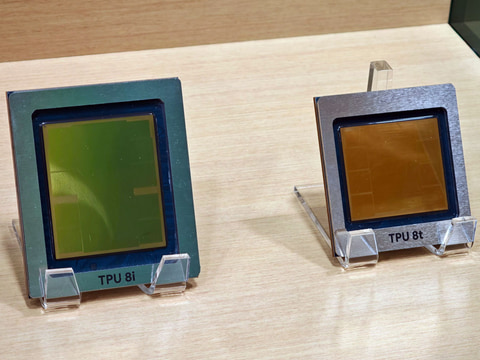

例えば、AIハイパーコンピュータであれば第8世代TPUとNVIDIA VeraRubin NVL72を採用したVM(インスタンス)を発表したし、エージェント型データクラウドでは、BigQueryでほかのクラウドにあるデータなどを高性能かつ低コストで利用できる仕組み「Cross-Cloud Lakehouse」を発表し、セキュリティではWizの買収を発表しそれをGoogle CloudのAIスタックに取り込むことを明らかにした。

また、エージェント型プラットフォームモデルでは、新「Gemini Enterprise」を発表。SaaSである「Gemini Enterprise App」や「Gemini Enterprise for Customer Experience」、Vertex AIの発展形としてエージェントサポート機能が多数追加された「Gemini Enterprise Agent Platform」、さらにはGemini 3.1 ProやAnthropicのAIモデルが追加されるなど、AIモデルに関しても追加されている。

さらにエージェント型タスクフォースでは、「Google Workspace」のAI新機能の追加などが明らかにされている。

確かに他社との比較で考えると、Amazon Web Services(AWS)はAIハイパーコンピュータ、データベース、セキュリティ、自社AIモデルやエージェントのプラットフォームなどは持っているが、Google Workspaceに相当するような製品は事実上持っていない。

その逆にMicrosoftは、Google Workspaceに相当するMicrosoft 365は持っているが、自社のAIモデルは持っておらず、OpenAIやAnthropicなどの他社モデルを採用する形になっている。その意味で、ハード、データベース、セキュリティ、AIモデル、エージェントなど、すべてを備えているのがGoogle Cloudだけだというのはその通りだと思う。

今回、三上氏に限らずGoogle Cloudの幹部は何度も「フルスタックのAIエージェントソリューション」を自社の強みとして強調し、その最後のピースになったのが「Gemini Enterprise」だと説明していた。

競争相手はもはやAWSやAzureではなく、OpenAIやAnthropicだと三上代表

こうした状況は、Google Cloudにとって大きな追い風になっているという。記者からの「2025年第4四半期決算ではグローバルは40%台後半の増収率と高い水準で推移しているが」との質問に対して、「細かなことはお話しできないが、Google Cloudの成長をけん引しているのがAIであることは明確だ。従来領域も伸長しているが、AI関連需要の伸びが極めて大きい。想定を上回る需要がグローバルで発生している。日本においても成長は上振れており、成長率は上昇基調にある」と回答した。

また、「日本での成長も主要因はAIだ。最近ではエンタープライズ領域でAIの本格導入を検討している企業が、Geminiの活用以降を示すケースが増加しており、市場環境の変化を実感している」とも述べ、Google Cloudの顧客が増加傾向である理由が、AI、その中でもGemini Enterpriseに代表されるようなAIエージェントを実際に実行する環境であり、そこで注目を集めていることが追い風になっていると述べた。

さらに、顧客が何を求めているのか、ほかのクラウドサービス事業者との競争状況について問われると、「まずは、Geminiを試行したいという単体利用の需要が存在する。一方で、業務適用フェーズに移行している顧客も増えており、当該需要の獲得を進めている。現在対話している顧客の多くは、業務変革にどのように活用するかという議論に移っている。すでに市場定義自体が AI/エージェント型エンタープライズへ移行しており、必ずしも従来のハイパースケーラー同士の比較軸のみで競争環境をとらえていない」と述べた。

そして、「重要なことは顧客のAI変革をいかに前進させるかである。AnthropicやOpenAI等は顧客でもある一方、技術進展をけん引する存在であり、切磋琢磨(せっさたくま)する関係である。変化速度が非常に速いことが最大のチャレンジであり、大規模組織であってもスタートアップ同様の俊敏性で継続的にアップデートしていくことが求められている」と三上氏は説明。今やGoogle Cloudが競争する相手はAWSやMicrosoft Azureといった従来型のクラウドサービス事業での競合ではなく、顧客でもあるAnthropicやOpenAIなどが競合だと認識していると説明した。

こうした、Gemini Enterpriseで作成されるようなAIエージェントへの日本企業の取り組みに関して、グーグル・クラウド・ジャパン合同会社 上級執行役員 パートナー事業 兼 法人営業統括 上野由美氏は「日本では、ITの取り組みがトップダウンであり、同時に、IT部門の下請けとしてSIを担ってきたパートナーが多いのが現状だ。そうしたトラディショナルなSIerの間でも自社変革が進んでおり、新しい顧客価値を提供したいという気運が高まっている」と前置き。

「以前のGoogle Cloud Nextには、どちらかというとクラウドネイティブなパートナーが参加いただくことが多かったが、今回はビッグフォーと言われるSIerからも多数参加いただいており、潮流の変化を感じている。われわれとしても、そうした変革を支援して、課題解決とエージェント実装を一体で進める枠組みをパートナーと共同で整備している」と述べ、米国で盛り上がっているエージェント実装のトレンドが今後日本でもトレンドとなる可能性を示唆した。

他社のストレージ上にあるデータも低コストに活用できるオープンな環境を実現

もう1つ、今回Google Cloudが強調したメッセージとして「オープン」ということがある。企業がAWSやAzureなどの複数のサービスを利用している場合に、Googleのフルスタックが生かせるのか?という質問に対し、グーグル・クラウド・ジャパン合同会社 執行役員 カスタマーエンジニアリング 統括技術本部長 渕野大輔氏は「日本企業がAWSやAzure等の別のクラウドを併用しているケースは一般的だ。AIエージェント活用においてわれわれのLLM基盤を利用いただくことは可能だが、それのみで全体課題が解決するわけではない」とする。

また、「基調講演でも示された通り、データ互換性・データ所在は重要論点であり、他クラウドにデータが存在する状況は、従来、導入障壁となっていた。これまでは、Google Cloudへデータを移し、そこでAIエージェントを活用するといった説明が中心だった。それに対して今回のアプローチでは、他クラウドにデータがある場合でもエージェントで活用可能なレイヤを提供しており、障壁は低下したと認識している。既存のSAPやERP等が他クラウド上にある場合でも、エージェントからMCP(Model Context Protocol)経由で接続する、あるいはエージェント間連携により接続するといった構成が可能となるため、接続面の障害は縮小すると見込んでいる」と述べ、今回発表された新製品などにより、そうしたデータ互換性・データ所在の問題は解決方向にあると述べた。

渕野氏が説明した「他クラウドにデータがある場合でもエージェントで活用可能なレイヤ」というのは、具体的には「Cross-Cloud Lakehouse」になる。

昨年のGoogle Cloud Next '25で発表された「Cross-Cloud Interconnect」という低遅延で低コストな広帯域ネットワークを活用し、AWSやMicrosoft Azureなど、ほかのクラウドサービス事業者のストレージにある顧客企業が所有しているデータに低遅延かつ低コストにアクセスできる。

基本的には、Google CloudがAWSやAzureなどに高速な専用線を用意して接続する。顧客企業が追加コストとして必要になるのは、他社クラウドからデータを取り出す時の他社クラウドでの負担だけとなる。このため、従来は両側(Google Cloud側と他社クラウド側)でかかっていたデータの取り出し、読み込みのコストが大きく低減されるというものになる。非常に誤解を恐れずに言えば、Googleが他社クラウドの上にSnowflake的なマルチクラウドのデータレイクを構築したようなものだと理解しておけば良いだろう。

それと同時に、Google Cloudは自社サービス(ストレージやデータベースなど)に対して、MCPサーバーからアクセスできるようにサービスを更新している。これにより、Gemini Enterprise Agent Platformを利用して作成された顧客のAIエージェントから、従来のGoogle Cloudのサービスに接続することが容易になる。もちろん、MCPそのものはオープンな規格なので、他社のAIエージェントと接続させるのも容易だ。

また、今回はAIモデルに関しても、Gemini(Gemini 3.1 Pro/Gemini 3.1 Flash Image/Lyria 3 Pro/Veo 3.1 Lite)などの自社開発のAIモデルに加えて、AnthropicのClaude Opus 4.7の追加が発表されている。そのように、自社モデルだけでなく、顧客が欲しいと思われるものに関しては他社モデルでも積極的に提供していく、そうした方向性であることをGoogle Cloudは明確にしている。

現状は既存データセンターの拡張で国内のニーズは満たせているが…

このほか記者からは、メモリやGPUなど、チップ供給の不足についての質問が出たが「GPU/TPUなどのチップ供給に関して、つまり、世界的なAI需要拡大の中でのキャパシティ確保は、各ベンダー共通の課題だ。Google Cloudとしては、自社チップであるTPUを持っていることが差別化になるが、現状は需要が高く、配置後にすぐに消費されるような状況だ。日本リージョンへの配備という観点では、グローバルに展開するLLM提供者などが世界規模でリソースの確保をするため、日本側で十分な量を確保するには継続的な取り組みが必要だ。一方、日本での需要が明確であれば投資が行われ、キャパシティ拡大につながる点は、従来のクラウド投資と同様の考え方である」(渕野氏)と、世界的な供給不足という中で、日本にTPUによるAIデータセンターなどを建設するには、需要を掘り起こす必要性があることを示唆した。

今、米国では、GPU、あるいはTPUなどのGPU代替のAIアクセラレータを採用した「AIデータセンター」「AIファクトリー」などと呼ばれるデータセンターの建設が、各地で行われている。そのくらい、AI学習に必要な演算性能がうなぎ登りという状況で、それに合わせてAIデータセンターの建設が進んでいるのだ。それに対して日本はどうかというと、そこまでの勢いはないというのが一般的な認識だろう。

三上代表は「需要拡大に応じてデータセンター能力は拡張していく。大規模新設のみならず、印西などの既存設備の増強も継続的に進めている。AIの進展により需要構造が急速に変化する中で、顧客へ迅速に提供できる体制を整えることが重要である。加えて、ソブリン要件等により、従来と異なる形でクラウドやAIを利用したいという要望も増えており、KDDIとの取り組み等を通じ、ソブリン関連のパートナーシップも拡大していく方針である。国内での活用が進展すれば投資も増加するため、エンタープライズにおけるエージェント活用をさらに推進していく」と述べ、既存のデータセンターでの拡張などで、日本の需要は今の所はまかなえているが、将来日本でも需要が爆発した時に備えて体制を整えていくことが重要だと説明した。

同時に、KDDI社の大阪堺データセンターの中にGDC(Google Distributed Cloud、顧客のデータセンターなどにGoogle Cloudのサーバーなどを置く取り組み)を設置するなどの取り組みを通じて、日本で強いニーズがあるソブリン要件への対応に関しても積極的に強化していきたいと述べた。