ニュース

データ侵害の被害額は減少傾向も、シャドーAIインシデントは高コストに――IBM調査

2025年9月3日 11:45

日本アイ・ビー・エム株式会社(日本IBM)は2日、「2025年データ侵害のコストに関する調査」について説明会を開催した。同調査は、2024年3月~2025年2月にデータ侵害を経験した16の国と地域の600社を対象とし、その対応に直接関わった担当者やリーダーにヒアリングした内容がベースとなっている。

日本IBM 執行役員 コンサルティング事業本部 成長戦略統括事業部 サイバーセキュリティー事業 セキュリティー・ソリューション&デリバリー担当の藏本雄一氏は、今回の調査のポイントとして、「データ侵害時に発生する平均被害額は444万ドルで、昨年比44万ドルの減少となった。また、平均侵害期間は241日で、昨年比で17日短縮された」と述べた。

日本IBM コンサルティング事業本部 サイバーセキュリティー事業 X-Forceインシデント・レスポンス日本責任者の窪田豪史氏によると、データ侵害時の平均総コストが前年比で減少したのは5年ぶり。日本においては、平均総コストが5億5000万円で、2018年以来8年ぶりにコストが減少した。「侵害の特定と封じ込めの処置が迅速化したことが、コスト削減に貢献した」と窪田氏は語る。

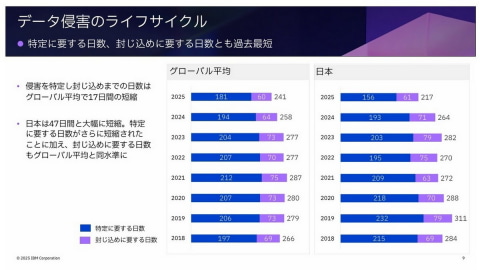

侵害の特定に要する日数と封じ込めに要する日数を調べたところ、特定から封じ込めまでの日数のグローバル平均は241日で、前年より17日短い結果となった。日本ではその日数が217日で、前年比47日の短縮だった。窪田氏によると、日本は例年封じ込めに要する日数がグローバル平均より長い傾向にあったというが、「今年は封じ込めに要する日数が61日で、グローバル平均(60日)と同水準になった」としている。

データ侵害の対応日数によるコストを比較したところ、特定から封じ込めまで200日未満のケースとそれ以上のケースでは、114万ドルのコスト差があったという。日本ではその差が2億円以上にものぼり、「グローバル平均以上の差が生じている」と窪田氏は指摘する。

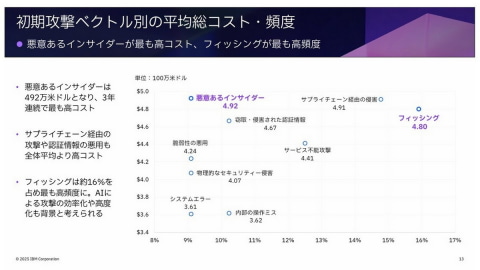

また初期攻撃ベクトル(最初の侵入手段)によるコストを調査したところ、「悪意のあるインサイダー」が492万ドルと、3年連続で最も高額な対応コストを要した。窪田氏は、「正規のアクセス権を持つ人物による侵害は発見が遅れやすく、結果的にコストが膨らむ傾向がある」としている。

一方、最も頻度が高かった侵入手段は「フィッシング」で、全体の約16%を占めた。対応コストも480万ドルと高水準で、「悪意のあるインサイダー」「サプライチェーン経由の攻撃」に次いで3番目に高コストだった。また、認証情報の窃取も増加傾向にあり、「正規ユーザーを装った攻撃や、信頼関係のある組織間での侵害は、検知が困難で影響範囲も広い」と窪田氏は述べている。

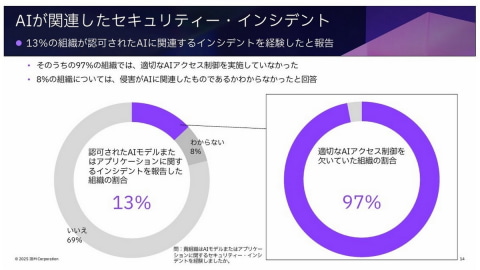

AI関連のセキュリティインシデントについては、「認可されたAIモデルやアプリケーションに関連するインシデントを経験したという回答が全体の13%にのぼった」と窪田氏。これらの組織の97%が、AIのアクセス制御に不備があったと回答しているという。また、8%の組織はAI関連の侵害があったかどうかすら把握できていないと答えており、ログ管理や利用状況の可視化が不十分なケースも多いと窪田氏は指摘している。

影響を受けたAIの形態としては、ChatGPTやMicrosoft CopilotなどのSaaS型AIサービスが最多で29%だった。一方、社内開発モデルやオープンソースAIもそれぞれ26%と高い割合でインシデントに関与していた。インシデントによる影響としては、「機密データへの不正アクセス」や「業務の一時停止」がそれぞれ31%にのぼった。

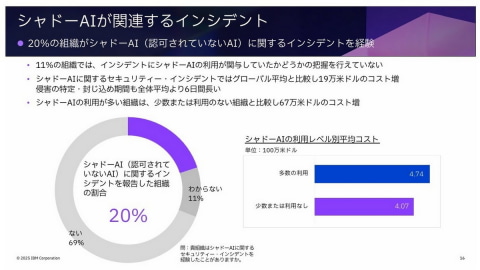

窪田氏は、認可されていないAI、つまりシャドーAIに関連するデータも紹介し、「20%の組織がシャドーAIに関するインシデントを経験している」として、認可されたAIでのインシデントよりも高い割合だと指摘した。また、11%の組織は、シャドーAIの関与自体を把握できていなかったという。

対応コストの面でも、シャドーAIが関与したインシデントはグローバル平均の444万ドルより19万ドル高い結果となり、シャドーAIの利用頻度が高い組織ではさらに67万ドル高いことがわかったという。

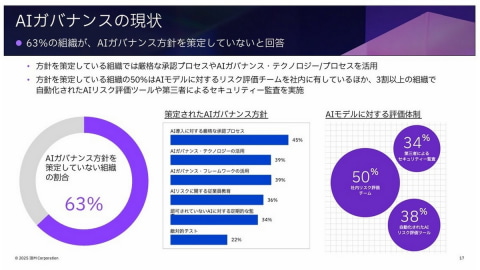

一方、AI関連のリスクに備えるガバナンス体制の整備は依然として不十分で、63%の組織がAIガバナンス方針を未策定と回答。この点について窪田氏は、「リスクが高まっており、具体的な影響を経験する組織も出てきているため、ガバナンスにも目を向けていく必要がある」としている。

策定されたAIガバナンス方針としては、AI導入に対する厳格な承認プロセスを準備している組織が45%、AIガバナンス技術やAIガバナンスフレームワークを活用する組織がそれぞれ39%、AIリスクに関する従業員教育を実施する組織が36%だった。また、50%の組織がAIモデルのリスクを評価する体制を整えているほか、34%が第三者によるセキュリティ監査を取り入れていることもわかった。

AIガバナンスの策定にあたっては、「特定の部門やチームだけで策定してもうまく回らず、矛盾が生じることもある。こうしたポリシーに関しては、部門横断的にプロセスに投資する必要がある」(窪田氏)とした。