ニュース

AI導入に必要なハードウェアの最適化を探る~Supermicro Innovate! JAPANレポート

2026年2月26日 06:30

スーパーマイクロは2月18日、代理店や顧客向けのイベント「Supermicro Innovate! JAPAN」を開催した。「ハードウェアの最適化が鍵を握る! 企業がAIを導入するための成功条件とは」と題したセミナーイベントでは、スーパーマイクロの他、チップベンダーやストレージベンダーなどが登壇した。本記事では、「企業がAIを導入するための成功条件とは」と題したユーザー企業向けセッションの内容から一部を紹介する。

エンタープライズAIの市場動向

スーパーマイクロは、1993年に米国サンノゼで創業した。これはくしくもNVIDIAと同じ年、同じ地域だ。サーバーメーカーとしては珍しく、自社で生産工場を持っているのが特徴。スーパーマイクロの佐野晶氏(FAE&ビジネスデベロップメント ゼネラルマネージャー)によれば、「AIコンピューターを作るに当たっては、自社でいろいろやらないとテクノロジーの進化に追いつかない」という。

日本向けは、台湾工場で製造している。現在マレーシアにも工場を建設しているので、アジア圏内向け製品は台湾を中心としてゆくゆくはマレーシアでも製造するようだ。ちなみに日本国内のサーバー出荷台数と売上高では、No.1のポジションを得ている。

岩佐英敏氏(FAE&ビジネスデベロップメント シニア マネージャー)のセッションでは、「海外導入事例にみるエンタープライズAIの可能性」と題して、海外の事例が多数紹介された。

まず、エンタープライズAI市場を地域ごとに見ると、ほぼ以下のような配分と用途になるという。

- 北米:55%

ハイパースケーラー、金融、ヘルスケア - ヨーロッパ:25%

テレコム、金融、製造業 - アジア:20%

クラウドサービスプロバイダー、製造業(半導体、自動車)

アジアでは、海外のハイパースケーラーがデータセンターを借りてサービスプロバイダーとして運用するケースが、他の地域と比較して多いのが特徴だ。日本もその傾向にあるが、これは東南アジアでも同様だという。

アプリケーションは多様で、メインのセグメントはエネルギー、自動車・航空宇宙、半導体設計という3つ。共通するトレンドは、高性能、高密度、高可用性、柔軟性、高速ネットワーク、広帯域、低遅延だ。

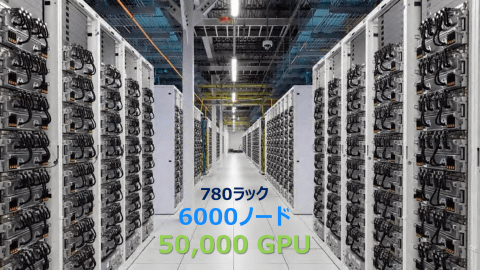

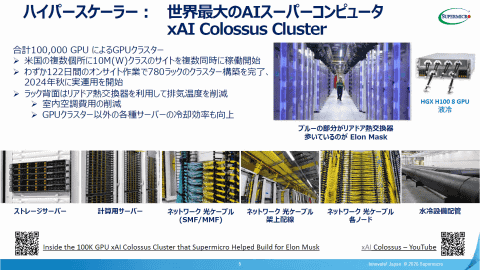

多様な事例が紹介されたが、ここではxAIの事例を紹介する。xAIのデータセンターは非常に大規模で、例えば1つの拠点で780ラック、6000ノード、5万GPUという規模で運用している。そのようなデータセンターが何カ所もあり、米国内の複数箇所で10MWクラスのデータセンターを同時に稼働させ、合計10万GPUによるクラスターをスーパーマイクロが構築している。

事例で紹介しているのは2024年に実運用を開始したGPUクラスターで、H200のGPUサーバーを高密度に集積し、リアドア熱交換器を採用している。ケーブリングなども含めて122日間で構築を完了させたとのことで、優れた構築パートナーと連携していることも、スーパーマイクロの特徴だ。このような高集積のサイトだけでなく、例えばコンテナに実装する際などは狭小なスペースでの作業が必要となるが、そちらにも対応している。

xAIのデータセンターでは、次世代のBlackwellクラスターが構築を完了し、既に運用が始まっている。

その他の海外事例として、全自動運転向け学習基盤、AI推論を使った検査装置といった製造業の事例の他、エネルギー分野やクラウドサービスプロバイダー、半導体の検査装置など、多様な事例が紹介された。

AI向けデータ基盤に求められるストレージの特徴

GPUについては、各チップベンダーが続々と新世代を開発し市場投入している。一方、ストレージ分野については見落としがちかもしれないので、そちらのセッションを少し紹介する。

データダイレクト・ネットワークス(DDN)は1998年にロサンゼルスで創業し、最初のユーザーはNASAで、HPC向けストレージベンダーとして知られている。日本でも「旧帝大が持っているような大型のスパコンのシェアとしては100%」(データダイレクト・ネットワークス・ジャパン Sales VP 秋元禮氏)とのことで、アカデミックやリサーチエリアで多く採用されている。

ただし、以前はエンタープライズの分野ではあまり知られていなかった。それが変わり始めたのは2008年頃の、「サーバーもネットワークも増強したのに、アプリケーションが速くならない」問題である。当時を覚えている方なら、原因がストレージだったというケースが多々あることを思い出すだろう。

データを参照するだけのシステムではあまり問題にならないが、書き込みも多いシステムでは、ストレージのI/O性能がアプリケーションのパフォーマンスを左右する。この頃から、DDNのエンタープライズ分野での知名度が上がってきたという。

さて、AIとHPCのインフラはかなり似ている。DDNとしてはこれまでのHPC分野の知見が生かせるため、現在はAIのマーケットに非常に力を入れており、日本でも数多く採用されている状況だ。

AIとHPCの大きな違いは、HPCのユーザーはHPCを研究している人たち、AIのユーザーはとにかく早くその環境を使いたい(投資回収したい)人たちだという点だろう。つまり、高価なGPUが、処理待ちで止まっている状態になるのは、ビジネス的に許容できないのがAIのユーザーだ。

ここで、ストレージのI/O性能が重要になってくる。DDNのI/O性能はReadはもちろんWriteも速いのが特徴で、NVIDIAのリファレンスアーキテクチャにも準拠している。さらに、日本法人が日本語でサポートしてくれるというのも、日本企業にとってはポイントが高い。「AIのインフラでは、高速なストレージと、それを安定運用することが重要なので、日本ではリピーターが多い」と秋元氏は言う。

ストレージベンダーはいわばソフトウェアの会社で、記録媒体自体は媒体のベンダーから仕入れて販売する。そのひとつがキオクシア(旧東芝メモリ)で、社名は「記憶+AXIA(ギリシャ語で価値あるもの)」からきている。

生成AIのシステム全体では、データレイクの他に一般用途のサーバー、AIの学習/推論サーバーがあるが、それぞれにSSDが使われている。キオクシアでは現在、推論サーバーの部分に注目していると、瀬戸弘和氏(SSD事業部 フラッシュストレージ事業戦略部 参事)は言う。簡単に言うと、GPUサーバーの内部にTLC SSDが内蔵されているが、プロンプトが来るたびにKVキャッシュを生成するのではなく、以前のものを再利用できれば、GPUの処理待ちを減らせるということだ。

また、生成AIにおけるストレージの課題として、以下のような課題がある。

- 大量データの効率的な処理

・データそのものがどんどん大きくなっている - GPU使用率の向上

・高価なGPUをできるだけ休ませたくない - GPUサーバー特有の要件

・GPUのスペースが広く、ストレージのドライブベイが少ない

・電力消費の効率化と液冷への対応

キオクシアでは、これらに対応するべく開発を進めているという。

企業がAIを導入するための成功条件とは

AI需要が高まっている現在、テクノロジーは非常に急速に変化している。「CPUでは世代が上がると性能が3倍から5倍と言われていたが、GPUではそれが20倍、30倍になる」とスーパーマイクロの佐野氏は言う。さらには、消費電力の増大、冷却機構の変化、高密度化など、さまざまな変化への対応が求められている。

また、高速ネットワークが必要になっていることから、サーバー同士を近接して置く必要がある。このため、高密度化も非常に重要なファクターだ。Ethernet規格の限界は100mなので、例えば消費電力が大きいため1ラックに1台しかサーバーを入れられないという状況で100台設置しようとすると、ケーブル長が足りなくなる。つまり高密度化が必須ということだ。そして高密度化すれば、必然的に冷却も必須になる。

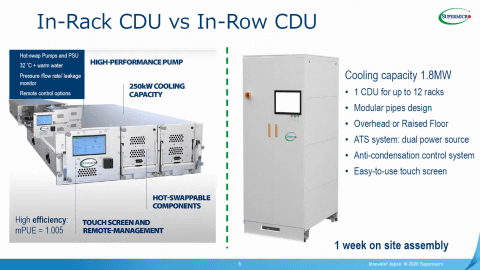

スーパーマイクロはサーバーベンダーだが、同時に冷却ソリューションも展開している。水冷サーバーに必要なCDU(Coolant Distribution Unit)は、In-Rack CDUとIn-Row CDUをラインアップする。違いとしては、IN-RackよりもIn-Rowの方がサーバーを高集積化できる。ただし、サーバーラック以外にCDUのスペースが必要になる点を考慮する必要がある。

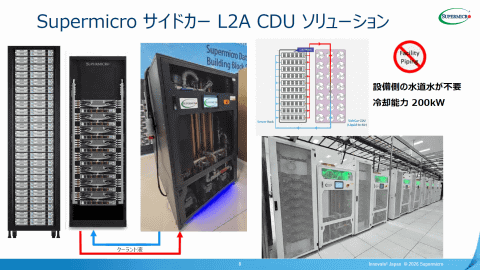

一方、データホールにファシリティの水を引けないというケースもまだ多い。そういう顧客向けのソリューションがサイドカー L2A CDUだ。「けっこう引き合いが多く、米国では去年100台以上出ている」と佐野氏は言う。L2Aというのは、Liquid to Air、水から空気ということで、ラックの横に置いて、暖まったクーラントをファンで冷やすというモデルだ。外から水を引く必要がないので、水冷必須のNVIDIAソリューションを導入したいがファシリティ側で水を引けないという企業に広がっている。

図では、ラックの隣にサイドカーという順番で配置されているが、これは必ずしも1対1である必要はない。サーバーの熱に応じて、例えば列の両端にサイドカーを置くなどの設計も可能だ。現在は200kWの冷却能力だが、今年度中に500kW版も出る予定で、より多くのラックをひとつのサイドカーで冷却できるようになる。

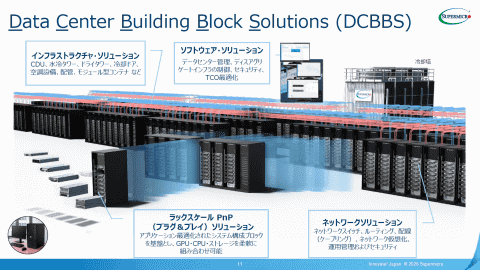

またスーパーマイクロでは、昨年6月にData Center Building Block Solution (DCBBS)というソリューションを発表している。サーバー、クライアント端末、CDU、冷却塔、それらを統合するソフトウェアソリューションから、ネットワーク系ソリューションまで、包括的に提供し、データセンター構築を支援するものだ。